Internetul post-uman: când conținutul real devine specie pe cale de dispariție

Potrivit unor cercetări recente, între 30 și 40 % din conținutul activ de pe internet este deja generat sau remodelat de inteligență artificială, iar o analiză realizată de Ahrefs în aprilie 2025, pe aproape 900 000 de pagini nou apărute, arată că 74,2 % dintre acestea conțin segmente produse sau asistate de algoritmi. Vorbim despre o transformare care dă frisoane: internetul devine un amestec tot mai dens de texte sintetice, în care vocea umană riscă să fie diluată până la imperceptibil. (surse: Spennemann, „Delving into: the quantification of AI-generated content on the Internet”, 2025; Ahrefs Research Report, aprilie 2025)

Utilizarea pe scară largă a ChatGPT și a modelelor generative similare a trezit tot mai multe îngrijorări în rândul experților privind „poluarea” internetului cu conținut produs de inteligența artificială. Aceste texte, adesea imposibil de deosebit de scrisul uman, sunt colectate și refolosite pentru antrenarea altor modele AI, creând un cerc vicios.

Fenomenul, numit „model collapse”, apare atunci când noile modele încep să-și piardă originalitatea, acuratețea și relevanța, fiind hrănite nu cu date autentice, ci cu material sintetic produs de alți algoritmi. Studii publicate în reviste de top, precum Nature, au confirmat că antrenarea sistemelor AI pe date generate anterior de alte modele le degradează treptat performanța.

Publicații majore – de la Scientific American la Business Insider și Financial Times – au avertizat la rândul lor că, dacă acest ciclu nu este întrerupt, dezvoltarea viitoare a AI-ului ar putea fi serios afectată. Ca răspuns, cercetătorii și companiile testează soluții precum watermark-uri invizibile, algoritmi de detectare a textului sintetic și conservarea dataset-urilor umane de înaltă calitate, pentru a garanta că modelele viitorului vor fi instruite pe informații reale și diverse.

Dar problema consumatorilor de social media este că tot mai mulți descoperă că nu mai pot distinge între o știre reală și una fabricată cu AI. Textele sunt impecabile, videoclipurile par verosimile, textele au acel „wow” al unei povești bune. Dar, după câteva secunde, apare senzația neliniștitoare: „Ce citesc sau văd e real sau e o ficțiune produsă de o mașină?”

Această stare de dezorientare cognitivă nu e paranoia individuală – este efectul firesc al unei inundații de conținut generativ care imită perfect stilul uman. Feed-urile ni s-au umplut de „clone” ale acelorași articole sau clipuri, semn că producția nu mai este umană, ci automată și infinită. Oamenii, însă, au timp finit. Din care deja petrec prea mult în fața ecranelor cu consecințe directe asupra IQ-ului… Ne cam tâmpim. (Am scris aici despre asta.)

Cum ne protejăm de balastul AI

Reputația sursei

În epoca AI, contează mai mult cine publică decât ce publică. Caută publicații cu redacție, editori, contact real.

Linkuri și citări

Un text serios are surse verificabile: date, nume, studii. Când lipsesc sau sunt vagi („experții spun”), semnal roșu.

Instrumente AI-detector

GPTZero, OpenAI Text Classifier sau NewsGuard pot semnala dacă un text e probabil generat. Nu sunt perfecte, dar reduc timpul de verificare.

Pentru texte și știri

-

NewsGuard

– Un serviciu cu oameni reali (foști jurnaliști) care evaluează credibilitatea site-urilor de știri. Îți apare ca extensie de browser și îți arată repede dacă sursa este „verde” (credibilă) sau „roșie” (dubioasă). -

GrepMed / Google Fact Check Tools

– Motorul oficial Google pentru a căuta verificări de fapte deja făcute de organizații precum AFP Fact Check, Snopes, Politifact. Introduci titlul sau numele din articol și vezi instant dacă cineva a verificat deja. -

OpenAI AI Text Classifier sau GPTZero

– Detectoare de text generat de AI. Nu sunt perfecte (false negative/pozitive există), dar îți pot da un indiciu rapid dacă textul are „semnătură” algoritmică.

Pentru imagini și video

-

InVID & WeVerify

– Extensie de browser creată pentru verificatori și redacții. Îți permite să faci „reverse search” pe cadre extrase dintr-un video, să vezi originea, metadate etc. -

Google Images / Yandex Images

– Pentru fotografii sau frame-uri video: click dreapta > „Search image with Google/Yandex”. Dacă imaginea e reciclată, apare rapid în alte contexte. -

FotoForensics

– Analizează structura unui fișier foto (EXIF, pixeli) și evidențiază zonele editate sau generate. Folosit și de echipe de investigație OSINT.

Pentru reputația sursei

Transparency Project – EU Digital Services Act

– Începe să apară un sistem european de listare a entităților care publică masiv. Poți verifica cine finanțează sau administrează un site.

Toate sunt reale, verificate, și sunt exact ce folosesc echipele de fact-checking (BBC Verify, Bellingcat, AFP Fact Check etc.). Combinate, îți reduc dramatic timpul pierdut: vezi instant dacă e reciclată o imagine, dacă un site e reputat și dacă textul e probabil AI.

Timp-limită. Dacă nu găsești dovada că e real în 2–3 minute, marchează conținutul ca „incert” și treci mai departe.

De ce e urgent să acționăm

Fără soluții rapide, oamenii riscă să obosească și să se retragă din verificarea conținutului, devenind ținte perfecte pentru manipulare subtilă. Exact acum se conturează standarde și inițiative („AI Act”, watermark-uri digitale, etichete „conținut uman verificat”). Dacă sunt implementate la timp, pot salva încrederea publică în informație – înainte ca feed-urile noastre să devină un amestec indistinct de balast.

Tendința pe termen lung

Nu e doar o percepție: fluxul de „balast AI” va crește exponențial. În paralel, se va dezvolta un ecosistem de „conținut certificat” (semnături digitale, watermark-uri, reputație). Marile agenții și reviste deja își pun la punct sisteme de autentificare, cum e cu fotografiile AFP sau AP.

Într-o lume inundată de imagini AI, semnătura AFP (Agence France-Presse) sau AP (The Associated Press) e un fel de „pașaport al realității”. Redacțiile mari (BBC, Le Monde, The Guardian, The New York Times) folosesc doar fotografii de la aceste agenții sau de la Reuters, Getty Images și EPA (European Pressphoto Agency), pentru că ele garantează că: fotograful există și era acolo, data și locul sunt reale, imaginea nu a fost generată sau manipulată. Probabil în 2–3 ani vom avea etichete vizibile „conținut uman verificat”, cum avem azi „organic” la mâncare. Până atunci, atenția și discernământul tău sunt un atu, nu o paranoia. Îți semnalează că nu ești în flux pasiv. Oamenii care încep să facă această diferență vor fi primii care se adaptează.

Esențial

– fenomenul de anxietate informațională e real, nu e paranoia.

– soluțiile există deja (reputația surselor + instrumente de verificare + reglementări clare).

– trebuie aplicate, cât încă mai avem reflexul de a verifica și discernământul de a ne îndoi. “Gândesc, deci mă îndoiesc; mă îndoiesc, deci exist.”E o versiune apocrifă, dar foarte frumoasă: exprimă exact reflexul uman de discernământ în fața iluziei perfecte.

N-o să vă supărați dacă încheiem cu definiția discernământului: este capacitatea de a deosebi adevărul de fals, esențialul de neesențial, binele de rău, autenticul de artificial. E o formă superioară de inteligență interioară — nu doar logică, ci și morală și intuitivă. Etimologic, vine din latinescul „a separa, a distinge, a vedea clar între”. A avea discernământ înseamnă:

- să nu reacționezi mecanic, ci să observi, să cântărești;

- să nu te lași dus de emoție sau aparență, ci să înțelegi contextul;

- să îți asumi responsabilitatea propriilor alegeri, pentru că știi de ce le faci.

În sens profund, discernământul e busola conștiinței.

La bune discerneri!

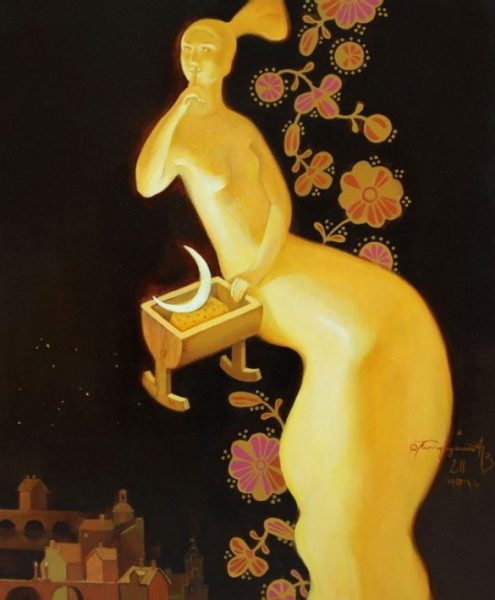

O garanție psihologică: cineva viu, cu discernământ, a stat aici, a citit, a filtrat pentru tine.

O garanție psihologică: cineva viu, cu discernământ, a stat aici, a citit, a filtrat pentru tine.

Citiţi şi

Anthropic: “Claude Mythos Preview, noul model de AI, este prea puternic pentru a fi lansat”

Rent A Human – când „roboții” angajează oameni

Criza globală a inteligenței din 2028 (raportul Citrini Research)

Acest articol este protejat de legea drepturilor de autor. Orice preluare a conținutului se poate face doar în limita a 500 de semne, cu citarea sursei și cu link către pagina acestui articol.